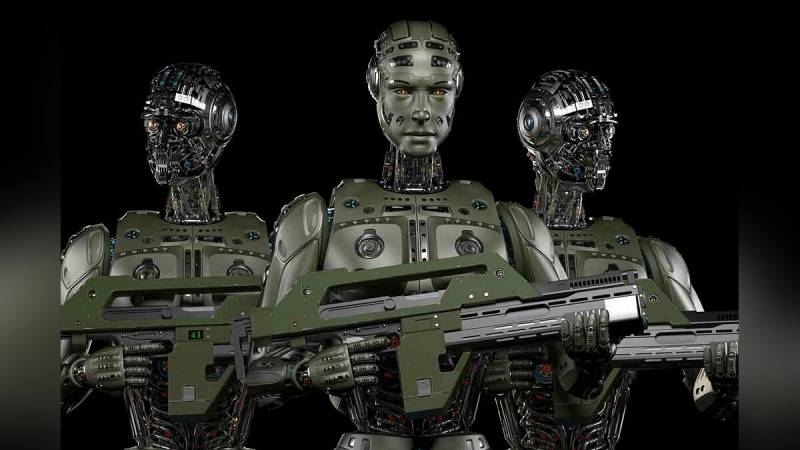

Note ale minții umane: americanii vor să schimbe inteligența artificială militară

Sursa: vgtimes.ru

Dezumanizarea digitală este anulată?

În primul rând, un avertisment din partea luptătorilor împotriva inteligenței artificiale militare:

Pacifiştii care cer ca toate lucrările de combatere a inteligenţei artificiale să fie îngheţate sunt împărţite în două tipuri. Primul este „Terminators” revizionat și alți analogi. Al doilea evaluează viitorul pe baza capacităților moderne ale roboților de luptă. În primul rând, vehicule cu aripi fără pilot echipate cu sisteme de lovitură.

Există o mulțime de episoade de ucidere eronată sau intenționată a civililor de către drone. În Orientul Mijlociu, american drone Mai mult de o ceremonie de nuntă a fost distrusă. Operatorii de roboți zburători au identificat împușcăturile de sărbătoare în aer ca un semn al luptelor de gherilă. Dacă o persoană special instruită nu este capabilă să determine detaliile unei ținte de la câteva sute de metri, atunci ce putem spune despre inteligența artificială. În prezent, viziunea automată nu poate fi comparată cu ochiul și creierul uman în ceea ce privește caracterul adecvat al percepției imaginii. Doar dacă nu obosește, dar acest lucru se poate rezolva și printr-o schimbare la timp a operatorului.

În mod clar, norii se adună peste inteligența artificială militară. Pe de o parte, există tot mai multe dovezi ale unei descoperiri tehnologice iminente în acest domeniu. Pe de altă parte, din ce în ce mai multe voci se aud în favoarea limitării sau chiar interzicerii muncii în această direcție.

Câteva exemple.

În 2016, a apărut o petiție în care gânditori proeminenți și alte mii de oameni au cerut ca inteligenței artificiale să nu primească arme letale. Printre semnatari se numără Stephen Hawking și Elon Musk. În ultimii șapte ani, petiția a strâns peste 20 de mii de semnături. Pe lângă preocupările pur umaniste legate de posibilitatea distrugerii necontrolate a oamenilor, există și inconsecvențe juridice.

Cine va fi judecat dacă sunt înregistrate crime de război comise prin inteligență artificială? Operatorul de drone care a incendiat mai multe sate cu civili este ușor de găsit și pedepsit în consecință. Inteligența artificială este produsul muncii colective a programatorilor. Este foarte greu să atragi o singură persoană aici. Alternativ, puteți judeca compania producătoare, de exemplu, aceeași Boston Dynamics, dar apoi cine va fi implicat în producția de drone autonome. Puțini oameni vor dori să fie în acuzația celui de-al doilea Tribunal de la Nürnberg.

Sursa: koreyaportal.com

Acesta este probabil motivul pentru care industriașii și programatorii încearcă să încetinească dezvoltarea abilităților de luptă cu inteligența artificială.

De exemplu, în 2018, aproximativ două sute de companii IT și aproape cinci mii de programatori s-au angajat să nu lucreze la sistemele autonome de luptă. Google spune că în cinci ani vor abandona complet contractele militare în domeniul inteligenței artificiale. Potrivit legendei, un astfel de pacifism nu este întâmplător - programatorii, după ce au aflat că scriau coduri pentru sistemele militare, au amenințat să renunțe în masă. Drept urmare, au găsit o variantă pe cale amiabilă - contractele existente sunt reziliate, dar altele noi nu sunt încheiate. Este posibil ca, mai aproape de data abandonării lucrărilor privind AI de luptă, „programatorii” insolubili să fie pur și simplu concediați și înlocuiți cu alții la fel de talentați. De exemplu, din India, care a fost de multă vreme faimoasă pentru resursele sale intelectuale ieftine.

Există, de asemenea, biroul Stop Killer Robots, care solicită liderilor mondiali să semneze ceva de genul unei Convenții pentru interzicerea IA a luptei. Până acum fără succes.

Toate cele de mai sus îi obligă pe oficialii militari să caute soluții alternative. Nu există nicio șansă ca președintele SUA să câștige alegerile dacă nu numai că promite grație universală LGBT, ci și interzicerea îmbunătățirii inteligenței artificiale militare.

Gândirea umană pentru AI

Pentagonul, se pare, este pe punctul de a face un fel de descoperire în AI. Sau era convins de asta. Nu există altă modalitate de a explica apariția unei noi directive care reglementează umanizarea sistemelor de luptă autonome. Kathleen Hicks, secretarul adjunct al Apărării al SUA, comentează:

I-ai auzit pe toți cei care sunt uimiți de roboții ucigași autonomi? Inteligența artificială americană va fi acum cea mai umană. Totuși, la fel ca americanii înșiși.

Sursa: robroy.ru

Problema este că nimeni nu înțelege cu adevărat cum să transmită proverbiala „judecata umană cu privire la folosirea forței” roboților cu arme. Formularea exactă a Conceptului a fost actualizată la sfârșitul lunii ianuarie trecute:

De exemplu, dacă, atunci când curățați o casă, un avion de atac aruncă mai întâi o grenadă în cameră, apoi intră în sine. Este aceasta judecată umană? Desigur, și nimeni nu are dreptul să-l judece, mai ales dacă a strigat mai întâi „Cine este acolo?” Ce se întâmplă dacă un robot autonom funcționează după aceeași schemă?

Judecata umană este un concept prea larg pentru a permite stabilirea oricăror limite. Este împușcarea prizonierilor ruși de către soldații Forțelor Armate ucrainene și gândire umană?

Adăugarea la Directiva Pentagonului 3000.09 privind sistemele de luptă autonome este plină de banalități. De exemplu,

Înainte de aceasta, se pare că au lucrat cu imprudență și nu în conformitate cu legile războiului.

În același timp, în presa americană și europeană nu există nici un indiciu de critică la adresa inițiativei Pentagonului din ianuarie. Sub falsa umanizare a inteligenței artificiale nu se află altceva decât o încercare de a masca ceea ce se întâmplă. Acum, armata americană va avea o monedă de negociere solidă în lupta împotriva oponenților inteligenței artificiale din armată. Uite, nu avem IA simplă, ci cu „un nivel adecvat de judecată umană”.

Având în vedere că încă nu există o definiție clară și general acceptată a „inteligenței artificiale”, toate scrisorile din jurul acesteia sunt percepute cu ironie. Macar.

Cum se face ca algoritmii matematici care lucrează cu cantități mari de date să joace judecata umană?

La această întrebare principală nu se răspunde în Directiva actualizată 3000.09.

informații